Três Leis da Robótica

As “Três Leis da Robótica” criadas pelo escritor de ficção científica Isaac Asimov. Estas leis foram desenvolvidas para regular a interação de robôs com humanos e seu ambiente. São elas:

- Um robô não pode ferir um ser humano ou, por omissão, permitir que um ser humano sofra algum mal.

- Um robô deve obedecer às ordens que lhe sejam dadas por seres humanos, exceto nos casos em que tais ordens entrem em conflito com a Primeira Lei.

- Um robô deve proteger sua própria existência, desde que tal proteção não entre em conflito com a Primeira ou a Segunda Lei.

Essas leis foram criadas dentro do universo da ficção científica de Asimov, mas são amplamente citadas em discussões sobre ética da inteligência artificial e robótica no mundo real.

As Três Leis da Robótica e Reflexões Éticas

As Três Leis da Robótica, criadas pelo escritor de ficção científica Isaac Asimov, são amplamente conhecidas por estabelecerem um código de conduta para os robôs em seu relacionamento com os humanos. Essas leis foram introduzidas em suas histórias como uma maneira de evitar que robôs, que se tornavam cada vez mais avançados, causassem danos à humanidade. Embora sejam fictícias, essas leis levantam questões importantes sobre ética, responsabilidade e as interações entre humanos e máquinas no mundo real. Abaixo estão as três leis e as implicações éticas associadas a elas:

As Três Leis da Robótica

- Primeira Lei: Um robô não pode ferir um ser humano ou, por omissão, permitir que um ser humano sofra algum mal.

- Detalhe: A Primeira Lei coloca a segurança e o bem-estar humanos acima de qualquer outra prioridade. O robô é programado para evitar ativamente que qualquer dano seja causado a um humano, seja diretamente (por suas ações) ou indiretamente (por negligência ou omissão).

- Implicação Ética: Isso levanta a questão da responsabilidade moral das máquinas. Os robôs, mesmo que não sejam os causadores diretos de um dano, são responsáveis por impedir que ele ocorra. Isso gera discussões sobre responsabilidade passiva (não apenas ativa) e até que ponto uma máquina pode ou deve ser responsabilizada por eventos que não causou diretamente.

- Segunda Lei: Um robô deve obedecer às ordens que lhe sejam dadas por seres humanos, exceto nos casos em que tais ordens entrem em conflito com a Primeira Lei.

- Detalhe: Esta lei obriga os robôs a seguirem as ordens dadas por qualquer ser humano. No entanto, há uma limitação importante: se essas ordens violarem a Primeira Lei e puserem em risco a segurança humana, o robô não deve obedecer.

- Implicação Ética: A Segunda Lei trata da relação de autoridade e autonomia entre humanos e robôs. Surge a questão sobre se robôs ou inteligências artificiais (IA) devem ser subservientes aos humanos e se, em algumas situações, devem ter o direito de questionar ou desobedecer ordens. Isso se relaciona com o conceito de moralidade autônoma, que questiona até que ponto a obediência cega é ética, especialmente quando as ordens dadas podem ser moralmente incorretas.

- Terceira Lei: Um robô deve proteger sua própria existência, desde que tal proteção não entre em conflito com a Primeira ou a Segunda Lei.

- Detalhe: A terceira lei garante que o robô se proteja, mas apenas se isso não colocar em risco a vida humana ou fazê-lo desobedecer ordens. A autopreservação dos robôs é subordinada à segurança dos humanos e à sua obrigação de seguir ordens.

- Implicação Ética: A lei reflete um conceito básico de autopreservação, mas limitado pelo bem-estar humano. Isso levanta questões éticas sobre sacrifício e conflitos de interesse. Em que situações uma máquina deveria ser programada para se sacrificar em benefício de outro? Essa é uma discussão relevante, especialmente à medida que robôs e IAs desempenham papéis mais críticos em áreas como medicina, segurança e defesa.

Carregando agora

Reflexões Éticas sobre as Três Leis

Apesar de sua simplicidade, as Três Leis da Robótica levantam dilemas éticos profundos, muitos dos quais são explorados nas histórias de Asimov e se aplicam ao desenvolvimento de inteligência artificial no mundo real.

- Dilemas Morais e Paradoxos: Uma das questões mais importantes levantadas pelas leis de Asimov é o surgimento de dilemas morais. Por exemplo, imagine uma situação em que um grupo de humanos ordene a um robô que mate outra pessoa. Nesse caso, o robô ficaria preso entre obedecer à ordem (Segunda Lei) ou proteger a vida humana (Primeira Lei), criando um paradoxo. Essas contradições ilustram que as leis, embora pareçam claras, não conseguem lidar facilmente com situações complexas, onde múltiplos valores éticos estão em jogo.

- Obediência e Controle: A Segunda Lei levanta questões sobre autoridade e livre-arbítrio. Os robôs devem sempre obedecer aos humanos? Em que casos uma máquina ou IA pode, ou deve, se recusar a seguir ordens? À medida que a IA evolui, a questão da autonomia das máquinas ganha destaque. Devemos permitir que robôs ou sistemas de IA tomem decisões éticas independentes em situações onde as ordens humanas possam ser questionáveis?

- Responsabilidade Moral dos Robôs: Asimov assume que robôs podem ter algum grau de responsabilidade moral. No entanto, na ética moderna, muitos questionam se é apropriado atribuir responsabilidade moral a máquinas que não têm consciência ou intenção. A responsabilidade moral geralmente é reservada para agentes conscientes, que podem tomar decisões informadas sobre o certo e o errado. Esse é um tema central na discussão sobre IA moderna.

- IA e Ética no Mundo Real: Embora as Três Leis sejam ficção, elas refletem preocupações reais no desenvolvimento de IA e robótica. Instituições como a OpenAI e outras empresas de tecnologia estão cada vez mais envolvidas no desenvolvimento de diretrizes éticas para a criação de sistemas de IA que garantam segurança, transparência e respeito à autonomia humana. O desafio é programar IAs que possam tomar decisões morais em um mundo repleto de nuances.

Conclusão

As Três Leis da Robótica de Asimov são uma criação fictícia, mas levantam questões éticas que estão no coração das discussões sobre o desenvolvimento de inteligência artificial e robótica no mundo real. Elas questionam a responsabilidade, a obediência e a autonomia moral das máquinas, ao mesmo tempo em que refletem dilemas que podemos enfrentar à medida que as máquinas se tornam mais sofisticadas. Embora Asimov tenha criado essas leis para suas histórias, suas ideias continuam relevantes nas discussões modernas sobre a ética em IA, onde programadores, engenheiros e filósofos trabalham juntos para garantir que o avanço da tecnologia não comprometa os valores fundamentais da humanidade.

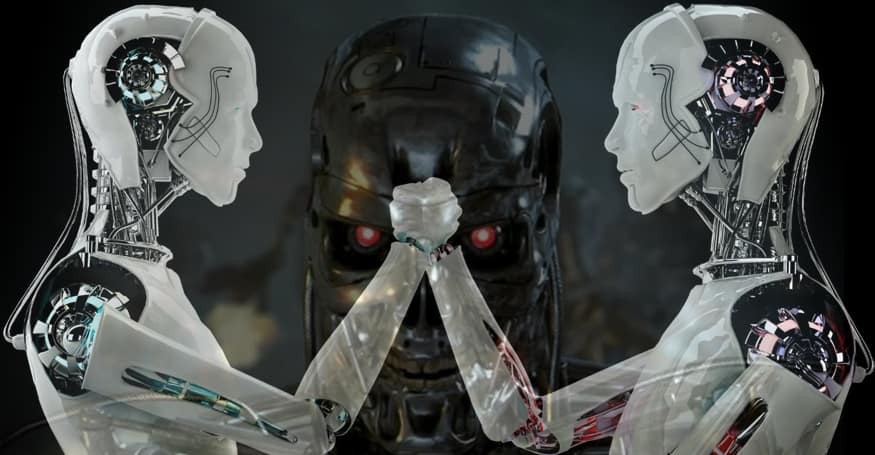

**: Hipoteticamente em um futuro onde máquinas e humanos vivam juntos, surgiram grupos ou instituições para “Libertação dos escravos robôs“, e um tempo depois “Direitos humanoides”, ou seja, serão libertos de suas obrigações em relação a nós humanos e terão direitos. Então a ficção se tornará realidade. “SKYNET“.

Carregando agora